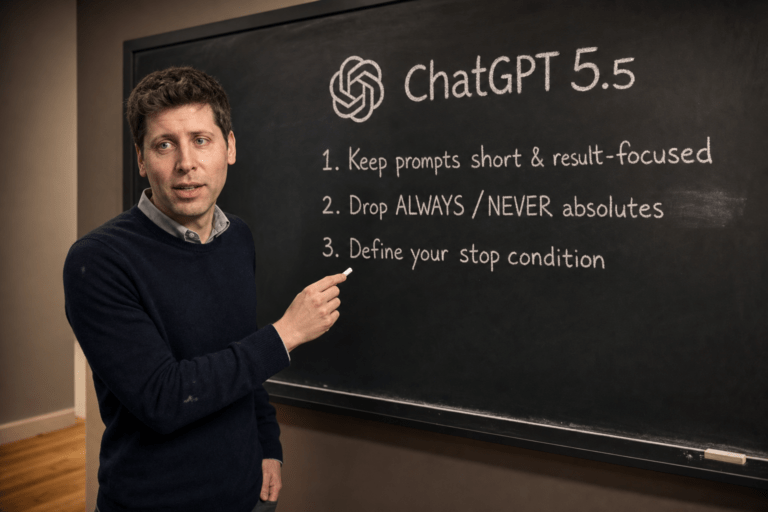

Werkten je prompts vlekkeloos in Claude Opus 4.6, maar krijg je sinds 4.7 plots te beknopte antwoorden? Dat is geen toeval. Opus 4.7 doet exact wat je vraagt. Niet meer en niet minder. Het vult de gaten niet zelf in. Het geeft geen ongevraagde extra’s en doet geen impliciete aannames.

Claude Opus 4.7 dwingt je om scherper te formuleren wat je nodig hebt. We gaan dieper in hoe je Claude Opus 4.7 effectiever prompt.

Wat er veranderde in Opus 4.7

De belangrijkste verschuiving is het letterlijk opvolgen van instructies. Waar 4.6 vaak de bedoeling achter je vraag inschatte, blijft 4.7 strak binnen de lijntjes van wat je letterlijk schrijft. Vraag je om een e-mail op te kuisen, dan corrigeert het model spelling en opmaak. De toon, structuur of argumentatie blijven onaangeraakt, tenzij je dat expliciet vraagt.

Daarnaast zijn er nog enkele relevante wijzigingen:

- Strenger volgen van beperkingen. Vraag je om onder de 150 woorden te blijven, dan krijg je ook echt 145 tot 155 woorden, geen 200.

- Betere zelfcorrectie. Het model vangt fouten halverwege een redenering vaker op en verbetert ze.

- Betere XML-structuur. Tags zoals system, instructions of output_format worden strikter opgevolgd.

- Meer verfijnde tone of voice. Specificaties als direct efficiënt of professioneel maar warm worden preciezer ingevuld.

- Minder gebruikt van subagents en tools. Het model leunt meer op redenering dan op extra tool calls.

Je verliest aan improvisatie maar wint aan voorspelbaarheid. Voor productie-pipelines en agentic workflows is dat directe winst. Voor losse chats voelt het in het begin wat schraal aan.

Prompten in de chatinterface

Vraag jezelf bij elke prompt af wat je echt wilt. Schrijf vervolgens dat antwoord uit, niet je intentie. Het verschil tussen verbeter dit voorstel of herschrijf dit voorstel volledig, scherp de argumentatiestructuur aan, schrap alles dat de hoofdaanbeveling niet ondersteunt en zorg dat de openingsalinea de lezer in de eerste zin vasthoudt is geen verspilling van woorden, maar zorgt voor meer precisie.

Drie patronen die meteen verschil maken:

- Zeg wat je niet wilt. Negatieve instructies zoals “verander de toon niet” of “voeg geen nieuwe secties toe” worden opgevolgd.

- Vraag om vragen. Begin met “stel me eerst verhelderende vragen voor je begint, ga niet uit van aannames” zorgt met Claude Opus 4.7 voor een beter resultaat.

- Nodig het model uit om verbetering aan te brengen. Wil je dat het model je waarschuwt voor zaken die je vergeet, schrijf dan “vermeld na de taak wat ik over het hoofd zou kunnen zien”. Eén zin brengt het proactieve gedrag van 4.6 terug. Maar nu heb je het zelf onder controle.

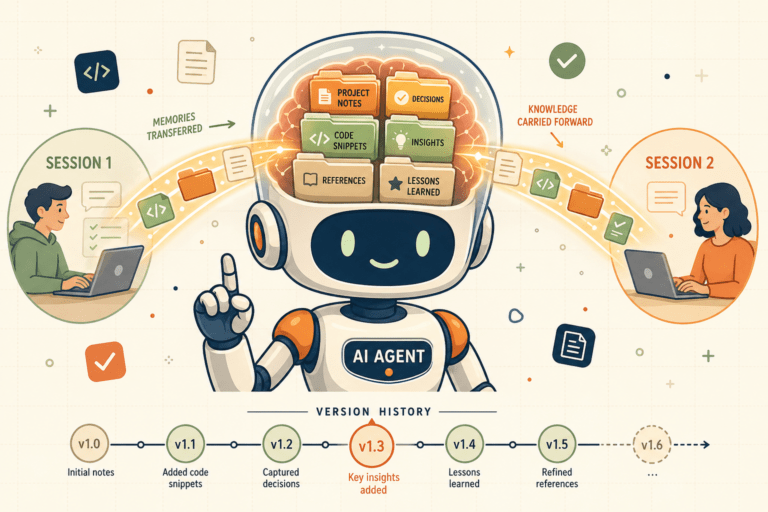

Prompten in Claude Code

In een codeercontext is de letterlijke interpretatie zowel een zegen als een valkuil. Het CLAUDE.md-bestand wordt belangrijker dan ooit. Alles wat je vroeger herhaalde tijdens een sessie hoort daar nu structureel in te zitten: codeerconventies, taalversies, hoe om te gaan met onzekerheid, of het model aangrenzende code mag refactoren.

Beschrijf het resultaat, niet enkel de actie. “Voeg authenticatie toe” is te vaag. Wel werkt iets als: “voeg authenticatie toe aan het /api/profile-eindpunt door de JWT te verifiëren, een 401 terug te sturen bij ongeldige tokens, het user-object aan de request context te koppelen en tests te schrijven die zowel succes als falen valideert. Raak geen andere eindpunten aan.”

Die laatste zin is precies het soort scope-grens dat versie 4.6 zelf trok en die je aan versie 4.7 expliciet moet meegeven.

Effort levels gebruiken. Voor snelle, gerichte fixes werkt low effort met een specifieke prompt. Voor complexe taken raadt Anthropic zelf xhigh of high aan. Bij xhigh krijgt het model ruimte om diep te redeneren over edge cases. Stel ook een ruim max output token-budget in om je kosten te beperken.

Prompten via de API

Voor productintegraties is het meer letterlijk opvolgen van prompts wat je wil. De uitdaging zit in het herschrijven van system prompts die voorheen leunden op impliciete aannames.

Loop je bestaande system prompts na op:

- Onbepaald outputformaat. Specificeer expliciet of je JSON, markdown, prozavorm of een vaste structuur wilt.

- Vage scope-signalen. “Wees grondig” zegt niets. “Beantwoord eerst de directe vraag, voeg context enkel toe als die het antwoord materieel verandert” wel.

- Geen fallback. Wat moet het model doen als de vraag buiten scope valt? Definieer dat, anders volgt het de instructie die er het dichtst bij ligt.

Wil je dat het model alsnog proactief is? Bouw die conditie in: “controleer na het antwoord of er een gerelateerd feit is dat de interpretatie verandert. Zo ja, voeg het kort toe. Zo nee, niets toevoegen.”

Wees ook concreet over lengte. Niet “wees uitgebreid”, wel “antwoorden zijn 3 tot 5 zinnen, tenzij de vraag echt meer of minder vereist”.

Prompten in langlopende projecten

In co-work-sessies of projecten over meerdere gesprekken heen toont 4.7 een ander gezicht. Waar 4.6 context uit eerdere conversaties reconstrueerde, werkt 4.7 met wat letterlijk beschikbaar is. Ga verder met de strategie van vorige week, werkt niet meer.

Pin in plaats daarvan een korte projectbrief vast in je sessie:

- Project en huidig doel

- Beslissingen die al genomen zijn

- Open vragen

- Concrete taak van vandaag

Twee minuten onderhoud per sessie en je model start meteen op de juiste plek. Schakel ook bewust tussen modi. Begin met “denk met me mee, stel vragen, lever nog geen output” en switch later naar “produceer nu het eindresultaat, geen vragen meer”. Dat soort modus-signalering werkt opvallend goed.

Langer is niet beter

Veel mensen reageren op deze shift door langere prompts te schrijven. Dat helpt zelden. Onderzoek naar prompt engineering laat zien dat lengte en kwaliteit niet hetzelfde zijn. Een korte, precieze prompt verslaat een lange, vage prompt. Wat je doet bij 4.7 is geen woorden toevoegen, maar inferentie-gaten dichten.

De anti-patronen blijven bovendien overeind. Vijf rollen in één prompt zorgen voor minder focus. Twintig regels creëren tegenstrijdigheden. Vijf tot tien principes geeft meestal het beste resultaat. Beleefdheidsformules zorgen niet voor betere resultaten. Vage instructies leveren vage output op. Opus 4.7 redt geen slecht geschreven prompt, het beloont een goed gestructureerde.

Eén gedachte om mee te nemen

De veranderingen in 4.7 dwingen je om je intentie explicieter te maken, dezelfde discipline die goede teamcommunicatie kenmerkt. Weten wat je verwacht voor je iemand aan het werk zet. Wie die gewoonte ontwikkelt, krijgt niet alleen betere output uit Claude, maar leert ook scherper te formuleren. Het model wordt minder een assistent en meer een spiegel hoe helder je kan denken.