Moonshot AI heeft met Kimi K2.6 een open-source model uitgebracht dat op de meeste agentic benchmarks gelijke tred houdt met GPT-5.4 en Claude Opus 4.6, en op een aantal vlakken zelfs beter scoort. Dat is opvallend, want K2.6 is volledig open-source en zelf te hosten. Hier lees je wat er concreet verbeterd is ten opzichte van K2.5, hoe de agent swarm-architectuur werkt en waarom dit model relevant is voor iedereen die serieus met AI-agenten aan de slag wil.

Wat is Kimi K2.6?

Kimi K2.6 is het nieuwste model in de K2-familie van Moonshot AI. Het gebruikt een Mixture-of-Experts (MoE)-architectuur met 1 biljoen parameters in totaal, waarvan er per token slechts 32 miljard actief zijn. Dat maakt inference betaalbaar zonder in te leveren op kwaliteit. De context window bedraagt 256.000 tokens en het model ondersteunt natively zowel afbeeldingen als video als invoer, via de ingebouwde MoonViT-encoder van 400 miljoen parameters.

K2.6 is beschikbaar via de officiële Moonshot API, via derde partijen zoals Fireworks en Novita, en kan zelf gehost worden via vLLM, SGLang of KTransformers. Met native INT4-kwantisering via Quantization-Aware Training is inference twee keer zo snel en verbruikt het model de helft minder GPU-geheugen in vergelijking met FP16.

Wat is er beter dan K2.5?

De verbeteringen tussen K2.5 en K2.6 zijn substantieel, verspreid over meerdere domeinen.

Minder hallucinaties

Een van de meest opvallende verbeteringen is de daling in het hallucinatiepercentage. Waar K2.5 nog een hallucinatiepercentage had van 65%, scoort K2.6 slechts 39%. Het model kiest er vaker voor om geen antwoord te geven dan om iets te verzinnen. Dat is een wezenlijk verschil in betrouwbaarheid, vergelijkbaar met Claude Opus 4.7 dat op 36% zit.

Sterk verbeterde prestaties op agentic taken

Op de GDPval-AA benchmark, die agentic taken zoals het maken van analyses en presentaties evalueert, steeg de Elo-score van 1309 bij K2.5 naar 1520 bij K2.6. Dat is een forse sprong. Op SWE-Bench Verified, de standaard benchmark voor softwareontwikkeling, haalt K2.6 80,2%, net iets onder Claude Opus 4.6 op 80,8%, maar boven GPT-5.4 op diverse andere criteria.

Betere codering over langere termijn

K2.6 is specifiek versterkt voor zogeheten long-horizon coding: complexe taken waarbij het model over vele stappen en uren autonoom moet blijven functioneren. Interne benchmarks tonen een stijging van 12% in codeernauwkeurigheid, 18% betere stabiliteit bij lange context en een tool invocation success rate van 96,6%. In een test optimaliseerde K2.6 autonoom een financieel matching engine gedurende 13 uur, met meer dan 1000 tool calls en meer dan 4000 gewijzigde coderegels. De doorvoer verdubbelde.

Verbeterde tool calling

K2.6 ondersteunt interleaved thinking: het model kan redeneren, een tool aanroepen, over het resultaat nadenken, een nieuwe tool aanroepen, en dat proces blijven herhalen in een autonome lus. Dit is essentieel voor complexe codering waarbij iteratief debuggen en testen noodzakelijk zijn. De tool calling voelt merkbaar strakker aan dan bij K2.5, iets wat ook door externe ontwikkelaars in vroege tests bevestigd werd.

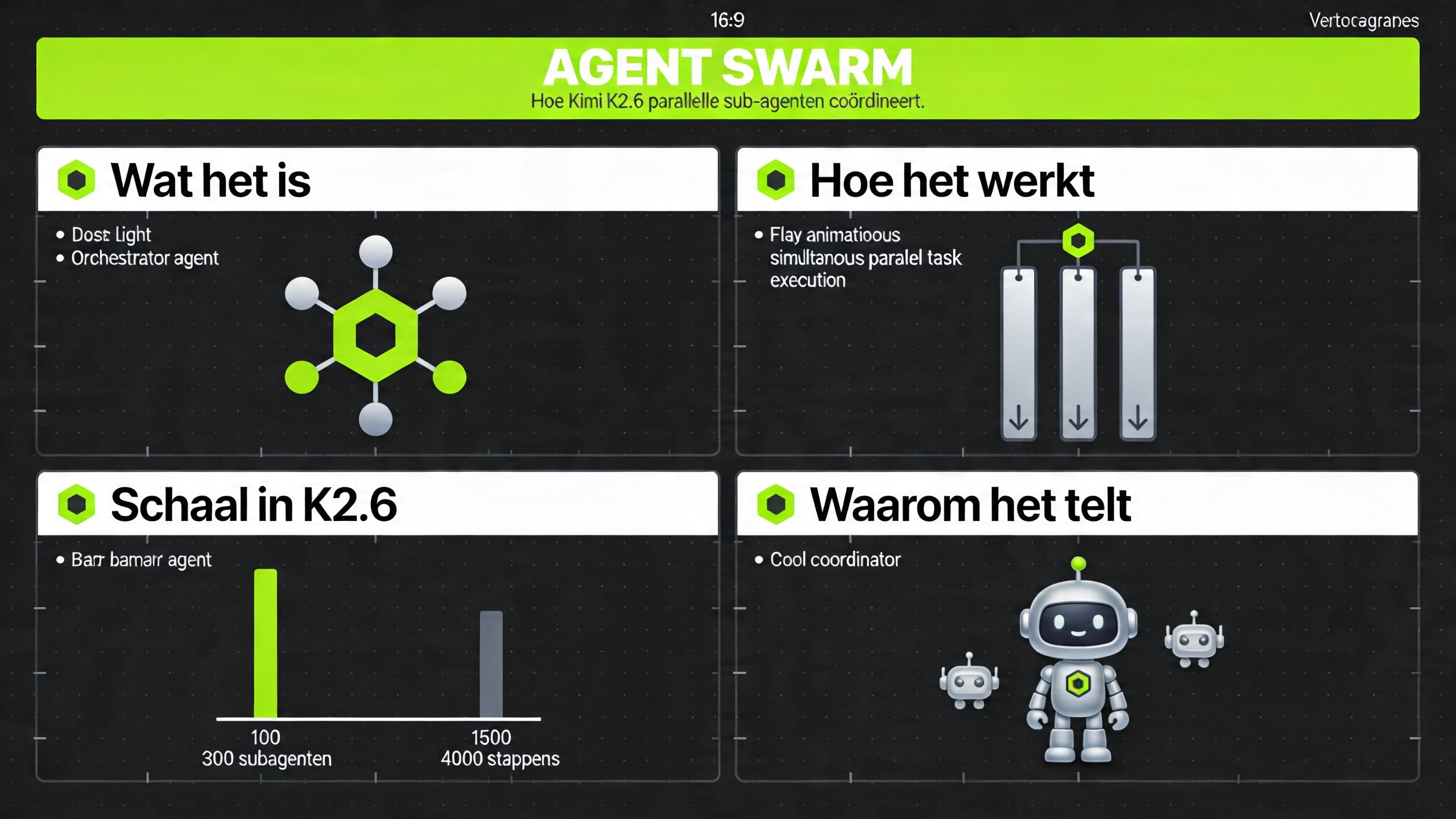

Wat is agent swarm?

Agent swarm is misschien wel de meest opvallende eigenschap van K2.6. De kern van het idee: in plaats van één model sequentieel door een taak te laten werken, coördineert het model een zwerm van parallelle sub-agenten die elk gespecialiseerd zijn in een deeltaak.

K2.5 ondersteunde al tot 100 sub-agenten met 1500 gecoördineerde stappen. K2.6 schraalt dat op naar 300 sub-agenten en 4000 stappen in één autonome run. Op de BrowseComp Agent Swarm benchmark scoort K2.6 daarmee 86,3%, tegenover 78,4% voor GPT-5.4.

Concreet betekent dit dat je met één prompt een volledige output kunt genereren die bestaat uit documenten, websites, spreadsheets en code, allemaal parallel en gecoördineerd door het model zelf. Het model decomponiseert de taak dynamisch, wijst deeltaken toe op basis van de vaardigheden van beschikbare sub-agenten, en stuurt bij als een sub-agent faalt of vastloopt.

Een voorbeeld uit de praktijk: Moonshot AI gebruikte intern een K2.6-gestuurde agent die vijf dagen lang autonoom monitoring, incidentresponse en systeembeheer uitvoerde, zonder menselijke tussenkomst. De agent handelde alerts af van begin tot einde, beheerde meerdere taken tegelijk en hield de context gedurende de volledige periode bij.

Claw Groups, agenten van derden welkom

Naast de ingebouwde swarm introduceert K2.6 ook Claw Groups als research preview. Dit is een open variant waarbij niet alleen Moonshot-agenten maar ook externe agenten en zelfs mensen als volwaardige deelnemers meedoen. Agenten kunnen draaien op verschillende apparaten, met verschillende modellen, elk met eigen tools en geheugen. K2.6 fungeert als de centrale coördinator die taken verdeelt, voortgang bewaakt en bijstuurt waar nodig.

Benchmarks in perspectief

K2.6 scoort 54,0% op Humanity’s Last Exam met tools, tegenover 52,1% voor GPT-5.4. Op BrowseComp haalt het 83,2% tegenover 82,7% voor GPT-5.4. Op puur wiskundig redeneren blijft GPT-5.4 sterker, maar op de agentic benchmarks die tellen voor echte toepassingen is K2.6 minstens gelijkwaardig en vaak beter dan de frontier alternatieven.

De API-kosten liggen op ongeveer $0,60 per miljoen invoertokens en $2,50 tot $3,00 per miljoen uitvoertokens, met automatische caching die 75 tot 83% besparing oplevert op hergebruikte prompts. Dat maakt K2.6 aanzienlijk goedkoper dan vergelijkbare gesloten modellen.

Open-source met frontier-niveau

Wat Kimi K2.6 onderscheidt, is niet één spectaculaire eigenschap maar de combinatie: frontier-niveau prestaties, volledig open gewichten, zelf te hosten, multimodaal, en nu ook met een agent swarm die schaalbaar is naar honderden parallelle agenten. De kloof tussen open-source en proprietary modellen was al kleiner geworden met K2.5; K2.6 maakt die kloof op de meeste agentic taken feitelijk onzichtbaar.