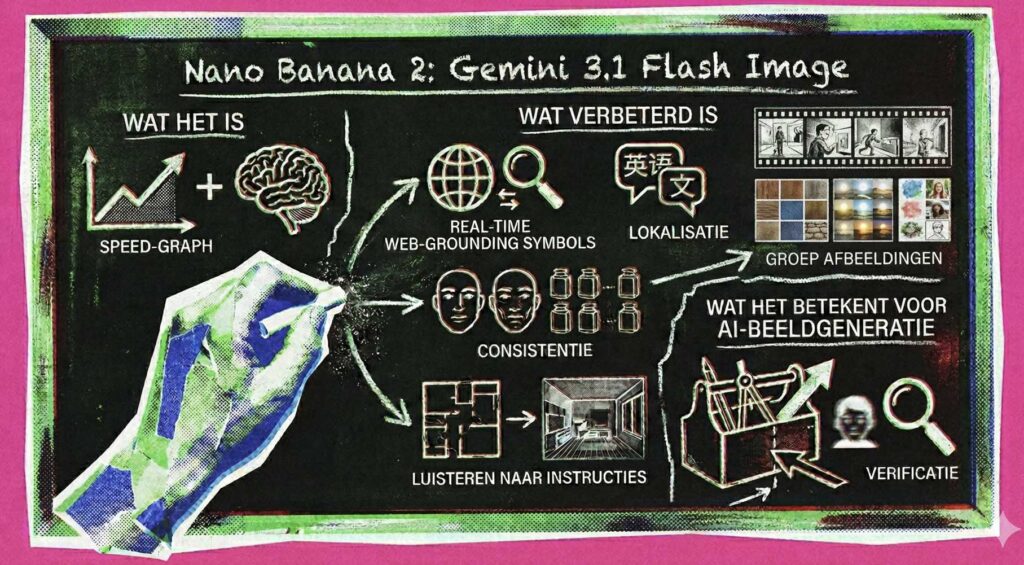

Nano Banana 2: wat het is, wat er verbeterd is en wat het betekent voor AI-beeldgeneratie

Op 26 februari 2026 lanceerde Google DeepMind Nano Banana 2, officieel bekend als Gemini 3.1 Flash Image. Het model is de opvolger van zowel het originele Nano Banana als Nano Banana Pro. Het levert een hoge beeldkwaliteit zonder in te boeten op snelheid.

Wat is Nano Banana 2?

Om te begrijpen wat Nano Banana 2 is, helpt het om even terug te kijken. Het originele Nano Banana verscheen in augustus 2025 en ging snel viraal. Drie maanden later volgde Nano Banana Pro, dat studiowaardige creatieve controle en geavanceerde intelligentie bood. Maar het model was trager.

Nano Banana 2 is het antwoord op die beperking. Het model combineert de geavanceerde kennis over de wereld, redeneervermogen en visuele kwaliteit van Nano Banana Pro met de generatiesnelheid van Gemini Flash. Het is beschikbaar via de Gemini-app, Google Search, Google AI Studio, de Gemini API en Vertex AI.

Wat is er verbeterd?

Nano Banana 2 brengt een reeks concrete verbeteringen mee ten opzichte van zijn voorgangers. Hieronder staan de belangrijkste.

Wereldkennis en real-time webgrounding

Een van de meest opvallende nieuwe mogelijkheden is dat Nano Banana 2 gebruikmaakt van real-time informatie en afbeeldingen uit Google Search. Dat betekent dat het model niet alleen werkt vanuit een statische trainingsset, maar actief informatie ophaalt om nauwkeurigere en meer contextgebonden beelden te genereren.

In de praktijk merk je dit bij het maken van infographics, educatief materiaal of locatiegebonden visualisaties. Een journalist van Wired testte dit door het model te vragen een weerinfographic te maken voor een skivakantie. Het resultaat zag er op het eerste gezicht goed uit, maar bleek verouderde weerdata te bevatten. Toen de fout werd aangewezen, paste het model de infographic zelfstandig aan met de juiste gegevens. Dat is een goed voorbeeld van hoe de webgrounding werkt: het model kan corrigeren en itereren op basis van actuele informatie, maar het vereist wel dat je de output kritisch bekijkt.

Voor developers biedt dit mogelijkheden voor toepassingen zoals reisapps met fotorealistische vensterweergaven gebaseerd op echte locaties en live weerdata, of marketingtools die automatisch gelokaliseerde visuals genereren voor internationale markten.

Verbeterde tekstweergave en lokalisatie

Tekst in AI-gegenereerde afbeeldingen was lange tijd een zwak punt van vrijwel alle modellen. Nano Banana Pro verbeterde dit al aanzienlijk, en Nano Banana 2 zet die lijn door. Het model kan nu betrouwbaar leesbare tekst renderen in afbeeldingen, wat het bruikbaar maakt voor marketingmateriaal, wenskaarten, bewegwijzering en infographics.

Wat nieuw is, is de in-image lokalisatie. Het model kan tekst in afbeeldingen niet alleen genereren, maar ook vertalen naar andere talen. In tests met architectuurvisualisaties werd tekst op gebouwen correct weergegeven in zowel Engels als Chinees, waarbij de vertaling na verificatie accuraat bleek. Voor bedrijven die content maken voor internationale markten is dit een functie die uren aan handmatig vertaal- en ontwerpwerk kan besparen.

Consistentie

Dit is een van de meest technisch indrukwekkende verbeteringen. Nano Banana 2 kan de gelijkenis van maximaal vijf personages en de visuele consistentie van maximaal veertien objecten bewaren over meerdere gegenereerde afbeeldingen heen. Dat betekent dat je een reeks beelden kunt maken, bijvoorbeeld een storyboard of een meerdelige verhaallijn, waarbij de personages er in elk beeld hetzelfde uitzien.

In de praktijk is dit iets wat eerder vrijwel onmogelijk was zonder handmatige nabewerking. Personages veranderden van uiterlijk tussen frames, objecten verdwenen of zagen er anders uit. Nano Banana 2 lost dit grotendeels op, wat het model bijzonder interessant maakt voor animatoren, illustratoren en iedereen die visuele verhalen wil vertellen.

Luisteren naar instructies

Nano Banana 2 volgt complexe prompts nauwkeuriger op dan zijn voorgangers. Het model houdt beter vast aan specifieke verzoeken, ook als die meerdere elementen combineren of gedetailleerde beschrijvingen bevatten. Dat maakt het verschil tussen een model dat een interpretatie geeft van wat je vraagt en een model dat doet wat je bedoelt.

In tests met architectuurvisualisaties bleek het model zelfs de ruimtelijke logica van plattegronden te analyseren voordat het een interieurvisualisatie genereerde. Dat soort begrip was in eerdere versies veel minder aanwezig.

Hoge resolutie en visuele kwaliteit

Nano Banana 2 ondersteunt resoluties van 512 pixels tot 4K en biedt volledige controle over beeldverhoudingen, waaronder 16:9, 9:16 en 2:1. Dat maakt het model geschikt voor uiteenlopende toepassingen, van verticale social media-posts tot brede achtergronden en printmateriaal.

Qua visuele kwaliteit sluit Nano Banana 2 de kloof met Nano Banana Pro aanzienlijk. Beelden hebben levendigere belichting, rijkere texturen en scherpere details dan het originele Nano Banana. In vergelijkende tests tussen Nano Banana 2 en Nano Banana Pro was het verschil in kwaliteit merkbaar maar klein, terwijl het verschil in snelheid groot was. Voor de meeste workflows is Nano Banana 2 daarmee de betere keuze.

Beschikbaarheid en gebruik

Voor gewone gebruikers is Nano Banana 2 beschikbaar via de Gemini-app en Google Search. In de Gemini-app vervangt het model Nano Banana Pro als standaard in de snelle en pro-denkmodussen. Gebruikers met een betaald abonnement kunnen nog steeds kiezen voor Nano Banana Pro via een aparte optie. Gratis gebruikers krijgen toegang tot twee à drie afbeeldingen per dag op hoge resolutie.

Voor developers is het model beschikbaar via de Gemini API in Google AI Studio, Vertex AI voor enterprise-toepassingen en ook via Firebase en Google Antigravity. De prijs hangt af van de resolutie. Een afbeelding van 512 pixels kost ongeveer 4,5 cent, terwijl 2K- en 4K-afbeeldingen anders geprijsd zijn.

Adobe Firefly, Figma, Notion en WPP hebben het model al geïntegreerd in hun workflows. Figma meldt dat het model responsief blijft na vele rondes van bewerkingen, terwijl Notion aangeeft dat beeldgeneratie door de snelheid van het model voelt als een natuurlijk onderdeel van het schrijfproces in plaats van een aparte stap.

Herkomst en verificatie van AI-gegenereerde beelden

Naarmate AI-beeldgeneratie beter wordt, wordt het ook moeilijker om te bepalen wat echt is en wat niet. Google pakt dit aan door SynthID te combineren met C2PA Content Credentials. SynthID is een technologie die een onzichtbaar watermerk inbedt in AI-gegenereerde beelden, video’s en audio. C2PA Content Credentials voegen daar een laag aan toe die niet alleen aangeeft of AI gebruikt werd, maar ook hoe.

Sinds de lancering van de SynthID-verificatiefunctie in de Gemini-app in november 2025 is die functie al meer dan twintig miljoen keer gebruikt in verschillende talen. Google kondigt aan dat C2PA-verificatie binnenkort ook beschikbaar komt in de Gemini-app. Voor enterprise-gebruikers biedt dit een niveau van transparantie dat steeds belangrijker wordt naarmate AI-gegenereerde content vaker opduikt.

Wat betekent dit voor AI-beeldgeneratie?

Waar je vroeger een keuze moest maken tussen snelheid en kwaliteit, of tussen toegankelijkheid en geavanceerde functies, verdwijnt die grens.

Voor creatieven betekent dit dat tools als Photoshop steeds vaker aangevuld of vervangen worden door AI-modellen die in seconden doen wat vroeger uren kostte. Architecten kunnen schetsen omzetten naar fotorealistische visualisaties. Marketeers kunnen gelokaliseerde campagnes genereren. Developers kunnen visuele prototypes bouwen vanuit een enkele prompt.

Tegelijk roept de verbetering van fotorealisme vragen op oververtrouwen. De Wired-journalist die het model testte, merkte op dat het steeds makkelijker wordt om overtuigende maar fictieve beelden van mensen te genereren. Google’s aanpak met SynthID en C2PA is een stap in de goede richting, maar de verantwoordelijkheid ligt ook bij platforms en gebruikers om kritisch te blijven kijken naar wat ze online zien.