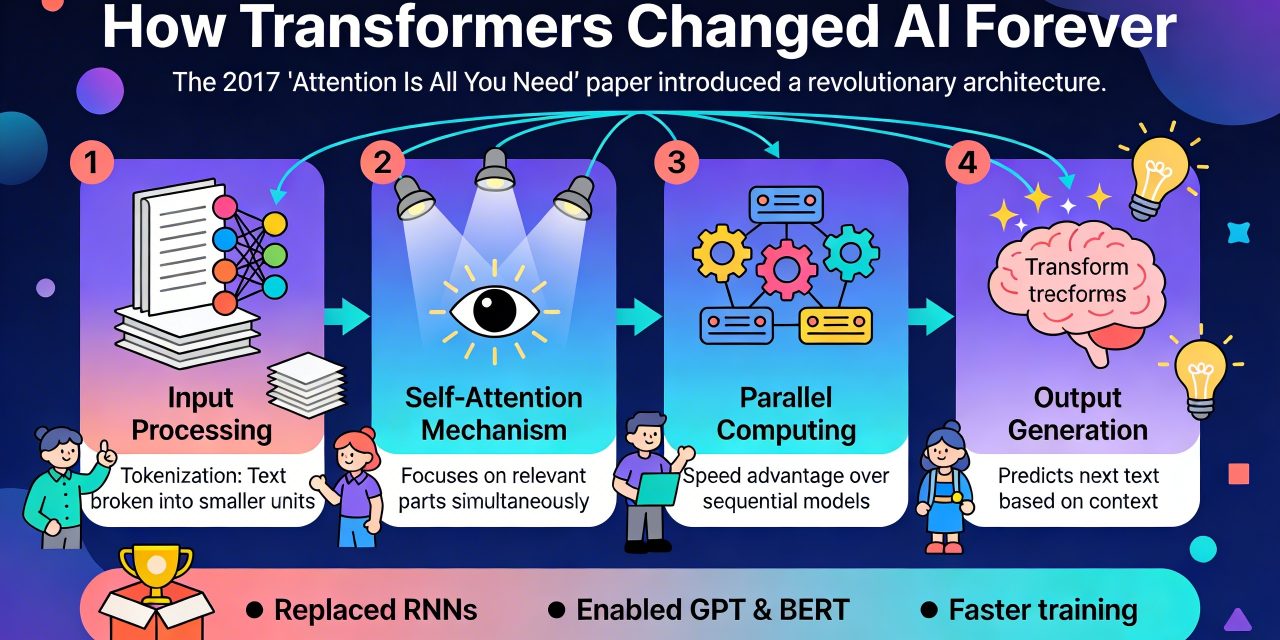

Een paper die de wereld van AI op zijn kop zette

In 2017 verscheen een paper die de manier waarop machines taal begrijpen fundamenteel zou veranderen. De titel was simpel maar ambitieus: Attention Is All You Need. Wat erin stond, zou de basis vormen voor vrijwel alle grote taalmodellen die we vandaag kennen. Om te begrijpen waarom deze paper zo belangrijk is, moet je eerst weten wat er voor bestond en wat het verving.

De auteurs

De paper werd geschreven door acht onderzoekers, allen verbonden aan Google Brain en Google Research. De auteurs zijn Ashish Vaswani, Noam Shazeer, Niki Parmar, Jakob Uszkoreit, Llion Jones, Aidan N. Gomez, Łukasz Kaiser en Illia Polosukhin. Het is een collectief werk van mensen die diep in de wereld van neurale netwerken en natuurlijke taalverwerking zaten. De paper werd gepresenteerd op de NeurIPS-conferentie van 2017 en is sindsdien een van de meest geciteerde wetenschappelijke publicaties in de geschiedenis van de informatica.

Het probleem met recurrente neurale netwerken

Om te begrijpen wat de paper oplost, moet je weten hoe taalverwerking voor 2017 werkte. De standaardaanpak voor taken zoals vertaling was het gebruik van recurrente neurale netwerken, ook wel RNN’s genoemd. Een RNN verwerkt een zin woord voor woord, van links naar rechts. Bij elk woord neemt het netwerk de informatie van het vorige woord mee in een zogenaamde verborgen toestand, een soort geheugen dat doorheen de zin wordt doorgegeven.

Stel je voor dat je de zin “De kat eet de muis” wil vertalen. Een RNN verwerkt eerst “De”, dan “kat”, dan “eet”, enzovoort. Bij elk stap wordt de verborgen toestand bijgewerkt. Het probleem is dat naarmate de zin langer wordt, de informatie over vroege woorden steeds verder verdund raakt. Tegen de tijd dat het netwerk bij het laatste woord aankomt, is de invloed van het eerste woord vaak al bijna verdwenen. Dit noemen onderzoekers het probleem van langetermijnafhankelijkheden.

Daarnaast zijn RNN’s traag te trainen. Omdat elk woord sequentieel verwerkt wordt, kan het netwerk niet parallel werken. Voor lange zinnen of grote datasets is dit een serieuze beperking. Er is ook het probleem van verdwijnende of exploderende gradiënten. Bij het terugpropageren van fouten door een lang netwerk worden de getallen ofwel zo klein dat ze niets meer bijdragen, ofwel zo groot dat het netwerk instabiel wordt.

Het transformer-model

De centrale bijdrage van Attention Is All You Need is de introductie van de transformer-architectuur. In plaats van recurrentie te gebruiken, vertrouwt dit model volledig op een mechanisme dat attention heet. De paper stelt dat je geen RNN nodig hebt als je attention goed genoeg implementeert.

Het transformer-model bestaat uit twee grote blokken: een encoder en een decoder. De encoder verwerkt de invoerzin en bouwt een rijke representatie op van elke positie in die zin. De decoder gebruikt die representatie om de uitvoerzin woord voor woord te genereren.

Wat is self-attention?

Het hart van het transformer-model is het self-attention mechanisme. Bij het verwerken van een woord kijkt het netwerk naar alle andere woorden in de zin tegelijk en bepaalt welke woorden het meest relevant zijn voor het begrijpen van het huidige woord.

Neem de zin “Het dier stak de straat niet over omdat het te moe was.” Wat verwijst “het” naar in het tweede deel van de zin? Voor een mens is dat duidelijk: het dier. Voor een algoritme is dat minder vanzelfsprekend. Self-attention lost dit op door het woord “het” te laten kijken naar alle andere woorden in de zin en een score te berekenen die aangeeft hoe sterk elk woord gerelateerd is aan “het”. Het woord “dier” zal een hoge score krijgen, waardoor het netwerk begrijpt dat “het” naar het dier verwijst.

Technisch gezien werkt self-attention met drie vectoren die voor elk woord worden berekend: een query, een key en een value. De query van een woord wordt vergeleken met de keys van alle andere woorden via een inwendig product. Dit geeft een score die aangeeft hoe relevant elk ander woord is. Die scores worden genormaliseerd via een softmax-functie en vervolgens gebruikt om een gewogen som van de values te berekenen. Het resultaat is een nieuwe representatie van het woord die informatie bevat over de context.

De schaling van de scores door de vierkantswortel van de dimensie van de key-vectoren is een technisch detail dat stabiliteit garandeert tijdens het trainen. Zonder die schaling kunnen de scores te groot worden, wat de softmax-functie instabiel maakt.

Multi-head attention

De paper introduceert ook het concept van multi-head attention. In plaats van één keer attention te berekenen, doet het model dit meerdere keren parallel, elk vanuit een ander perspectief. Elke kop leert andere aspecten van de relaties tussen woorden te modelleren. Eén kop kan leren om syntactische relaties te herkennen, een andere kop kan semantische relaties oppikken. Door de resultaten van alle koppen samen te voegen, krijgt het model een rijkere representatie van de invoer.

In de originele paper worden acht attention-koppen gebruikt. De dimensie van elke kop is de totale dimensie gedeeld door het aantal koppen, zodat de totale rekenkost vergelijkbaar blijft met één grote attention-berekening.

Positionele codering

Een belangrijk verschil met RNN’s is dat het transformer-model geen inherente notie heeft van volgorde. Een RNN verwerkt woorden sequentieel, waardoor de positie van een woord automatisch gecodeerd is. Bij een transformer worden alle woorden tegelijk verwerkt, waardoor de volgorde verloren gaat.

De oplossing die de paper voorstelt, is positionele codering. Aan de inbedding van elk woord wordt een vector toegevoegd die de positie van dat woord in de zin codeert. De auteurs gebruiken sinus- en cosinusfuncties van verschillende frequenties om deze positionele informatie te representeren. Het voordeel van deze aanpak is dat het model ook kan omgaan met zinnen die langer zijn dan de zinnen waarop het getraind werd.

De rest van de architectuur

Naast attention bevat elke laag van de encoder en decoder ook een feedforward neuraal netwerk dat op elke positie onafhankelijk wordt toegepast. Residuele verbindingen en laagnormalisatie zorgen voor stabiliteit tijdens het trainen. In de decoder is er ook een gemaskeerde versie van self-attention, waarbij het model bij het genereren van een woord alleen naar eerder gegenereerde woorden mag kijken en niet naar toekomstige woorden. Dit is noodzakelijk om te voorkomen dat het model tijdens het trainen spiekt.

De verbinding tussen encoder en decoder verloopt via cross-attention. Hierbij komen de queries uit de decoder en de keys en values uit de encoder. Op die manier kan de decoder bij elke stap kijken naar de meest relevante delen van de invoerzin.

Resultaten en prestaties

De paper toont aan dat het transformer-model beter presteert dan de toenmalige state-of-the-art modellen op machinevertaling, en dat terwijl het aanzienlijk sneller te trainen is. Op de WMT 2014 Engels-Duits vertaaltaak behaalt het model een BLEU-score van 28,4, wat beter was dan alle eerder gepubliceerde modellen inclusief ensembles. Op de Engels-Frans taak behaalt het een score van 41,0.

Wat minstens even belangrijk is als de prestaties, is de trainingssnelheid. Omdat het transformer-model volledig parallel werkt, kan het veel efficiënter gebruik maken van moderne GPU’s en TPU’s. De auteurs rapporteren dat hun model in acht uur getraind kan worden op acht GPU’s, terwijl vergelijkbare RNN-modellen dagen nodig hadden.

Waarom is deze paper zo belangrijk?

De impact van Attention Is All You Need is moeilijk te overschatten. De transformer-architectuur die erin beschreven wordt, is de directe voorloper van vrijwel alle grote taalmodellen die sindsdien zijn ontwikkeld. BERT, GPT-2, GPT-3, GPT-4, T5, LLaMA, Gemini. Ze zijn allemaal gebaseerd op de transformer. De paper heeft niet alleen de wereld van natuurlijke taalverwerking veranderd, maar ook andere domeinen zoals beeldherkenning, spraakverwerking en eiwitstructuurvoorspelling.

De paper toont aan dat recurrentie niet noodzakelijk is voor het modelleren van sequenties. Ten tweede laat ze zien dat attention een krachtig mechanisme is dat langetermijnafhankelijkheden kan modelleren zonder het probleem van verdwijnende gradiënten. Ten derde maakt de parallelle aard van het model het mogelijk om te schalen naar veel grotere datasets en modellen dan voorheen mogelijk was.

Die schaalbaarheid bleek achteraf de belangrijkste eigenschap. Naarmate onderzoekers meer rekenkracht en meer data beschikbaar hadden, konden ze steeds grotere transformer-modellen trainen. De prestaties bleven verbeteren op een manier die met RNN’s nooit mogelijk was geweest. Dit leidde uiteindelijk tot de opkomst van grote taalmodellen en de huidige golf van generatieve AI.

Van vertaling naar universeel model

De originele paper richt zich op machinevertaling, maar de architectuur bleek veel breder toepasbaar. Onderzoekers ontdekten al snel dat je een transformer kunt voortrainen op grote hoeveelheden tekst zonder specifieke labels, en het model daarna kunt finetunen voor specifieke taken. Dit idee, dat bekend staat als transfer learning, werd de dominante aanpak in de verwerking van natuurlijke taal.

BERT, gepubliceerd door Google in 2018, gebruikte de encoder van de transformer om een model te trainen dat tekst in beide richtingen begrijpt. GPT van OpenAI gebruikte de decoder om een model te trainen dat tekst genereert. Beide modellen zijn directe afstammelingen van de transformer uit de paper van 2017.

Wat maakt de paper tijdloos?

Naast de technische bijdragen is de paper ook opmerkelijk helder geschreven. De auteurs leggen elk onderdeel van de architectuur stap voor stap uit en motiveren elke ontwerpkeuze. De visualisaties van attention-patronen, waarbij je letterlijk kunt zien welke woorden het model met elkaar associeert, maakten de paper toegankelijk voor een breed publiek van onderzoekers.

De naam zelf, Attention Is All You Need, is een bewuste provocatie. Het is een statement dat ingaat tegen de heersende overtuiging dat recurrentie onmisbaar was voor sequentieverwerking. De jaren na de publicatie bevestigden keer op keer dat attention inderdaad voldoende is, en in veel gevallen superieur.

De erfenis van een paper

Zeven jaar na publicatie is Attention Is All You Need nog steeds de meest invloedrijke paper in de geschiedenis van de moderne AI. De transformer-architectuur is niet alleen de standaard geworden voor taalmodellen, maar heeft ook de manier veranderd waarop onderzoekers nadenken over het modelleren van relaties in data. Het idee dat je elk element in een reeks direct kunt laten interageren met elk ander element, zonder tussenliggende stappen, is een conceptuele doorbraak die ver voorbij taalverwerking reikt. Wat begon als een oplossing voor een vertaalprobleem, is uitgegroeid tot de architecturale basis van de meest krachtige AI-systemen die tot nu zijn gebouwd.