Je opende deze week je vertrouwde prompt, drukte op enter en kreeg iets terug dat anders was. Geen bug, geen storing, een resultaat dat mechanisch aanvoelt of juist te beperkt blijft. Sinds de release van Claude Opus 4.7 en ChatGPT 5.5 publiceerden zowel Anthropic als OpenAI nieuwe promptgidsen. Hun advies, gooi je oude prompts overboord. Maar om compleet tegenovergestelde redenen.

Twee modellen, twee filosofieën

Claude Opus 4.7 stopte met gokken naar wat je bedoelde. Het model doet exact wat je vraagt. Niets meer, niets minder. Vage instructies die nog prima werkten op 4.6 leveren nu korte, letterlijke, zwakkere resultaten op. Het model is niet dommer geworden. Het stopte simpelweg met compenseren voor slordig denkwerk.

GPT-5.5 ging precies de andere kant op. Oude prompts beschrijven het proces te gedetailleerd, omdat eerdere modellen die hand nodig hadden. GPT-5.5 heeft dat niet meer nodig. Die extra details creëren ruis en leiden tot mechanische output.

Claude werd letterlijker. GPT werd autonomer. Beide modellen straffen nu prompts die zonder helder denkwerk geschreven zijn af.

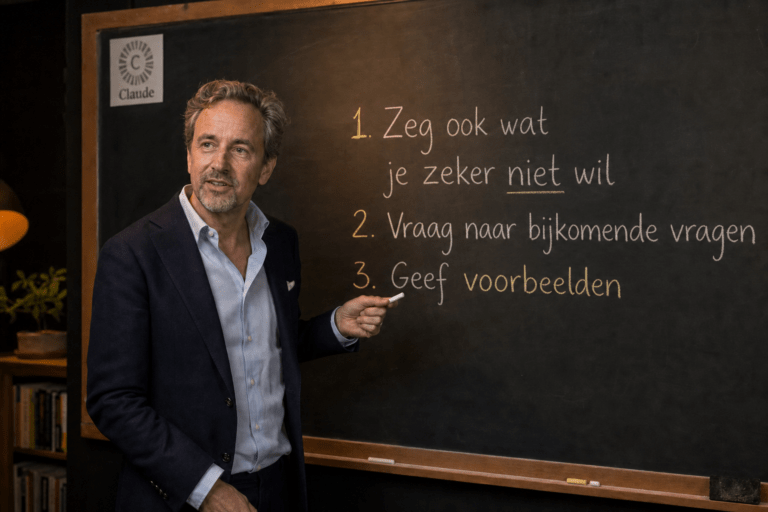

Hoe je Claude Opus 4.7 effectief aanstuurt

Anthropic stemde 4.7 af op voorspelbaarheid. Het model interpreteert prompts letterlijk, houdt zijn antwoorden strakker afgebakend en biedt minder ongevraagde informatie aan. Zachte taal zoals overweeg, je zou kunnen of voel je vrij om wordt nu als optioneel opgevat. Directieven zoals je moet of altijd worden als verplicht geïnterpreteerd.

Wat dit concreet betekent voor je prompts:

- Beschrijf de scope, niet alleen de taak. Verbeter dit voorstel levert je een paar woordwissels op. Wil je een echte herschrijving, omschrijf dan de gewenste uitkomst: herschrijf dit voorstel van nul, scherp het argument aan, schrap alles wat de hoofdaanbeveling niet ondersteunt en maak de openingszin krachtiger.

- Gebruik negatieve beperkingen. Regels als verander de toon niet of leg niet uit wat je hebt aangepast worden nu daadwerkelijk gevolgd.

- Vraag het model om vragen te stellen. Voor complex werk werkt de volgende instructie: stel eerst eventuele verduidelijkende vragen voor je begint. Aanname is uit den boze.

- Nodig observaties van het model expliciet uit. Het proactief signaleren van problemen dat 4.6 standaard deed, is verdwenen. Je krijgt het terug door te vragen: vertel na afloop wat je opviel maar wat ik niet vroeg.

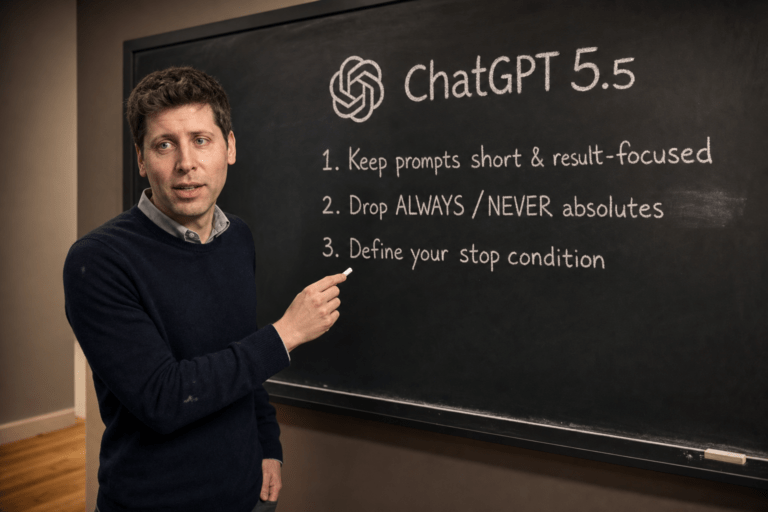

Hoe je GPT-5.5 effectief aanstuurt

De grootste verschuiving bij GPT-5.5 is de stap van procesinstructies naar outcome-first prompting. Vertel het model hoe een goed resultaat eruitziet, welke beperkingen ertoe doen, welk bewijs er is voor een goed resultaat en wat het eindantwoord moet bevatten. Daarna laat je het model zelf bepalen hoe het tot het beoogde resultaat komt. Geen genummerde lijst met stappen, geen herinnering om zorgvuldig na te denken. De bestemming is helder, dus kiest het model een efficiënte route.

Belangrijk:

- Wees voorzichtig met absolute taal. Oude prompts staan vaak vol met altijd en nooit. GPT-5.5 volgt die letterlijk, met als gevolg dat nuance verdwijnt. Gebruik vooral beslisregels.

- Definieer wanneer een taak klaar is. Zonder stopconditie blijft een redeneermodel doorgraven en tokens verbranden. Geef het model expliciet toestemming om te stoppen, met een kwaliteitscheckpoint.

Dezelfde conclusie, andere route

Een ontwikkelaar op Reddit analyseerde honderden community-posts over de upgrades. De klachten correleerden bijna perfect met promptspecificiteit. Precieze prompts kregen betere resultaten op 4.7. Vage prompts kregen slechtere. Het model werd niet slechter. De prompts waren niet goed genoeg.

OpenAI’s nieuwe framework heet outcome-first prompting: beschrijf hoe goed eruitziet, definieer succescriteria, stel beperkingen, en laat hert model de rest doen. Anthropic’s framework is het omgekeerde: wees chirurgisch specifiek over wat je wilt, want het model vult jouw blanco vlakken niet meer in.

Twee verschillende architecturen. Twee verschillende filosofieën. Een identieke conclusie, degene die de prompt schrijft is de bottleneck, niet het model.

De echte vaardigheid zit bij jou

Boris Cherny, de engineer achter Claude Code, postte op de releasedag dat zelfs hij een paar dagen nodig had om zich aan te passen. Anthropic verhoogde ondertussen de rate limits voor abonnees, omdat de nieuwe tokenizer tot 35% meer tokens gebruikt op dezelfde input. Het model is duurder om te draaien met luie prompts en goedkoper met precieze prompts.

De kloof tussen goede en slechte output draait niet langer om welk model je kiest. Het draait om het gestructureerd nadenken voordat je begint te typen. Jouw denksysteem is de skill. De prompt de vertaling hiervan. Wie dat onder de knie krijgt, merkt dat de keuze tussen Claude en GPT minder belangrijk wordt dan de helderheid van de hersenen die ze aanstuurt.