Mamba 3 is een State Space Model, vaak afgekort tot SSM, dat ontworpen is met één duidelijk doel voor ogen: betere prestaties leveren bij inference zonder de latentie uit de hand te laten lopen. Als je wilt begrijpen waarom onderzoekers er zoveel aandacht aan geven, dan moet je vooral kijken naar waar grote taalmodellen vandaag het meeste tijd en geld verbruiken. Dat is niet alleen training, maar steeds vaker het genereren zelf. Zeker bij agents, codegeneratie, reasoning en post training workflows telt elke milliseconde tijdens decode.

Precies daar probeert Mamba 3 zich te onderscheiden. Het model bouwt voort op eerdere Mamba versies, maar verschuift de focus. Waar Mamba 2 vooral sterk inzette op trainingssnelheid, is Mamba 3 veel explicieter ontworpen voor inference. Dat maakt het niet automatisch beter dan een transformer in elke situatie, maar wel erg relevant als je zoekt naar een modelarchitectuur die sneller met lange sequenties kan omgaan en minder afhankelijk is van een steeds grotere geheugenbuffer.

Wat is Mamba 3

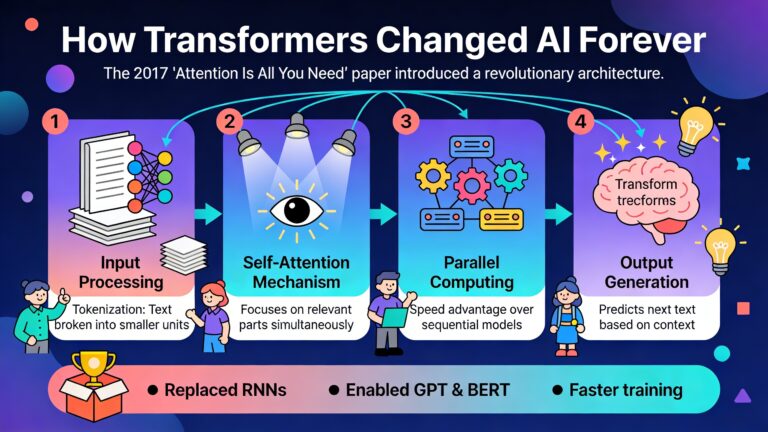

Mamba 3 is een lineair sequentiemodel binnen de familie van State Space Models. In gewone taal betekent dat dat het model tekst niet verwerkt door alle eerdere tokens steeds opnieuw rechtstreeks te vergelijken, zoals een transformer dat doet via self attention. In plaats daarvan houdt Mamba 3 een compacte interne toestand bij. Die toestand wordt bij elk nieuw token geüpdatet en bevat een samengevat beeld van wat eerder belangrijk was.

Dat vaste toestandsformaat is de kern van het idee. Bij een transformer groeit de interne geheugenstructuur mee met de lengte van de input via de KV cache. Dat is krachtig, omdat het model veel exacte details uit het verleden kan bewaren. Maar het kost ook veel geheugen en bandbreedte. Een SSM zoals Mamba 3 probeert hetzelfde probleem op een andere manier op te lossen. Het bewaart niet alles letterlijk, maar probeert de geschiedenis slim te comprimeren in een toestand met vaste grootte.

Waarom Mamba 3 als alternatief voor transformers wordt gezien

Als je naar transformers kijkt, zie je meteen waarom alternatieven aantrekkelijk zijn. Self attention is heel sterk in het ophalen van relevante informatie uit de context. Daardoor zijn transformers goed in retrieval taken, in context learning en precieze verwijzingen naar eerdere tokens. Tegelijk heeft die kracht een prijs. De rekenkost en vooral de geheugenlast nemen toe naarmate je context langer wordt. Bij deployment en inference kan dat snel een knelpunt worden.

Mamba 3 pakt dat anders aan. Omdat het werkt met een vaste toestand, schaalt de rekenkost lineair met de sequentielengte. Dat maakt het interessant voor lange contexten en voor workloads waarin veel tokens gegenereerd moeten worden. Denk aan agent systemen die voortdurend nieuwe stukken tekst of code produceren. In zulke scenario’s is niet alleen modelkwaliteit belangrijk, maar ook hoe efficiënt je promptverwerking en token per token generatie blijven.

Dat is ook waarom Mamba 3 niet gewoon een kleine update is. Het model vertrekt vanuit de vraag hoe een SSM eruit moet zien als inference, en niet training, de eerste ontwerpprioriteit is. Daardoor verschilt het niet alleen van transformers, maar ook van eerdere lineaire modellen die vooral gebouwd waren om pretraining sneller te maken.

Hoe een State Space Model anders werkt dan een transformer

Het makkelijkste verschil om te onthouden is dit. Een transformer bewaart het verleden als een groeiende databank. Elk nieuw token kan via attention terugkijken naar de volledige cache. Een State Space Model bewaart het verleden als een dynamische toestand die bij elke stap wordt aangepast. Je krijgt dus geen groeiende opslag, maar een doorlopende update van één compact geheugen.

Dat heeft voor en nadelen. Het voordeel is duidelijke efficiëntie. Je hoeft niet steeds meer geheugen te verplaatsen of een langere cache te beheren. Het nadeel is dat het model selectiever moet zijn. Alles uit het verleden moet namelijk in die vaste toestand passen. Daardoor zijn retrieval taken van nature moeilijker voor pure lineaire modellen dan voor pure transformers.

Juist daarom is de kwaliteit van de recurrente update zo belangrijk. Als de toestand te simpel wordt bijgewerkt, dan verlies je modelkracht. Dat was een belangrijke les uit eerdere SSM ontwerpen. Mamba 3 probeert dat probleem op te lossen door die update rijker en expressiever te maken zonder de inference snelheid op te offeren.

Hoe Mamba 3 werkt

De werking van Mamba 3 draait rond drie grote verbeteringen. De eerste is een expressievere recurrentie. Bij elk nieuw token voert het model een rijkere toestandsupdate uit dan in eerdere versies. Dat klinkt technisch, maar het effect is helder. De vaste toestand moet meer werk doen, dus de manier waarop je die toestand bijwerkt mag niet te arm zijn.

De tweede verbetering is een rijkere transitiematrix. In eerdere ontwerpen werden onderdelen van het SSM sterk vereenvoudigd om training sneller te maken. Dat hielp wel, maar het haalde ook dynamiek uit het model. Mamba 3 brengt daar opnieuw meer structuur in, zodat de toestand informatie flexibeler kan meenemen over tijd.

De derde verbetering is extra parallel werk binnen elke update. Dat is vooral slim vanuit hardwareperspectief. Tijdens decode zijn veel lineaire modellen niet echt rekenbeperkt, maar geheugenbeperkt. Dat betekent dat de GPU niet vastloopt op te veel berekeningen, maar op het heen en weer schuiven van data. Mamba 3 gebruikt een deel van die ongebruikte rekencapaciteit om per stap meer nuttig werk te doen zonder de latentie veel te verhogen.

Een opvallend detail is dat Mamba 3 ook complexe toestanden ondersteunt. Dat gebeurt via een interpretatie waarin complexe transities zich gedragen als rotaties. Hiervoor wordt RoPE gebruikt op een manier die past binnen de SSM structuur. Het praktische gevolg is dat het model rijkere dynamiek kan leren zonder een volledig nieuwe en zware kernelimplementatie nodig te hebben.

Daarnaast is er een MIMO variant, wat staat voor multi input multi output. Die variant breidt de representatie van bepaalde projecties uit, zodat het model meer informatie tegelijk kan verwerken. In de gepubliceerde resultaten levert dat betere nauwkeurigheid op, terwijl de decode latentie ongeveer gelijk blijft. De training duurt dan wel langer, dus dit is geen gratis winst, maar vooral een verschuiving van kost naar de fase waar je die beter kunt dragen.

Wat er architecturaal veranderde ten opzichte van eerdere Mamba versies

Mamba 3 veranderde niet alleen de kern van het SSM. Ook de laag zelf werd herwerkt zodat die beter aansluit bij moderne taalmodellen. Een van de belangrijkste toevoegingen is QKNorm, in SSM context ook BCNorm genoemd. Die normalisatie stabiliseert de training en brengt Mamba 3 dichter bij technieken die je ook bij transformers en andere sterke lineaire modellen ziet.

Een tweede belangrijke verandering is het verdwijnen van de korte causale convolutie die in eerdere Mamba versies nog een externe rol speelde. In Mamba 3 wordt een vergelijkbaar effect deels intern opgevangen door de nieuwe recurrentie en door biases op de relevante projecties. Met andere woorden, iets wat vroeger buiten de SSM laag zat, wordt nu implicieter binnen de toestandsupdate gerealiseerd.

Verder gebruikt Mamba 3 interleaved MLP lagen, net zoals moderne transformers. Dat maakt de architectuur minder exotisch en praktischer om te vergelijken met bestaande modellen. Voor implementatie op hardware werd ook veel aandacht besteed aan kernels in Triton, TileLang en CuTe DSL. Dat zijn geen details die je als gebruiker elke dag nodig hebt, maar ze verklaren wel waarom Mamba 3 in benchmarks niet alleen theoretisch efficiënt is, maar ook in echte latency metingen sterk presteert.

De voordelen van Mamba 3

- Lineaire schaalbaarheid met sequentielengte

Als je met lange contexten werkt, is dat een groot voordeel. De kost groeit beheersbaarder dan bij klassieke attention. - Sterke inference efficiëntie

Mamba 3 is expliciet ontworpen voor snelle promptverwerking en snelle decode. Dat is precies waar veel productieworkloads vandaag op draaien. - Betere kwaliteit dan eerdere Mamba versies

De rijkere recurrentie, complexere toestanden en MIMO projecties zorgen ervoor dat het model niet alleen snel is, maar ook inhoudelijk sterker presteert dan Mamba 2 in taalmodellering. - Minder afhankelijk van een groeiende KV cache

Je hoeft niet voor elk extra token een steeds grotere aandachtcache mee te dragen. Dat helpt bij geheugenverbruik en deployment. - Goed geschikt voor hybride modellen

Omdat lineaire lagen efficiënt geheugenachtig gedrag bieden, kunnen ze sterk werken naast attention lagen die juist goed zijn in exacte retrieval.

In gepubliceerde benchmarks op modellen rond 1,5 miljard parameters liet vooral de SISO variant sterke latencyresultaten zien bij prefill en decode. De MIMO variant bleef qua decode dicht in de buurt, maar haalde betere nauwkeurigheid. Dat onderstreept het centrale idee achter Mamba 3. Je kunt meer modelcapaciteit in de update stoppen, zonder dat inference automatisch evenredig trager wordt.

Waar transformers nog steeds sterker zijn

Het is belangrijk dat je Mamba 3 niet ziet als een volledige vervanger voor transformers. Op retrieval taken blijven transformers meestal in het voordeel. Dat is logisch. Een transformer kan via de KV cache veel preciezer teruggrijpen naar specifieke informatie uit het verleden. Een puur SSM moet diezelfde informatie comprimeren in een vaste toestand en verliest daar soms detail.

Juist daarom verwachten veel onderzoekers dat de toekomst niet puur transformer of puur SSM zal zijn, maar hybride. In zo’n opzet krijg je het beste van beide werelden. Lineaire lagen leveren efficiënte sequentieverwerking en lagere geheugenlast. Attention lagen zorgen voor exacte toegang tot relevante context wanneer dat echt nodig is.

Waarom dit belangrijk is voor de volgende generatie AI systemen

Als jij kijkt naar waar grote modellen vandaag in de praktijk voor gebruikt worden, dan zie je een duidelijke verschuiving. Het gaat steeds minder alleen over eenmalige pretraining en steeds meer over langdurige inference. Agents plannen taken, schrijven code, testen, herhalen, corrigeren en genereren enorme aantallen tokens. In zo’n wereld wordt architectuurkeuze opnieuw een harde productiebeslissing, niet alleen een academische voorkeur.

Mamba 3 is daarom interessant omdat het een serieuze poging is om sequentiemodellering opnieuw te ontwerpen rond echte inference druk. Niet rond een theoretisch ideaal, maar rond de vraag hoe je kwaliteit en snelheid beter in balans brengt wanneer systemen langdurig moeten draaien.

Wat je vooral moet onthouden

Mamba 3 is een State Space Model dat laat zien dat een alternatief voor transformers niet per se aandacht volledig hoeft te kopiëren om relevant te zijn. De architectuur kiest bewust voor een compacte toestand, lineaire schaalbaarheid en een rijkere recurrente dynamiek. Daardoor is het model vooral sterk waar inference telt. De belangrijkste nuance is tegelijk de interessantste. Mamba 3 wijst waarschijnlijk niet naar een wereld zonder transformers, maar naar een wereld waarin lineaire modellen en attention veel slimmer naast elkaar gebruikt worden.